一键AI去衣工作流终极版

本文最后更新于 2024-08-14,

若内容或图片失效,请留言反馈。部分素材来自网络,若不小心影响到您的利益, 请联系我 删除。

本站只有Telegram群组为唯一交流群组, 点击加入

文章内容有误?申请成为本站文章修订者或作者? 向站长提出申请

在使用本工作流前请务必先阅读基础篇教程并完成前置工作

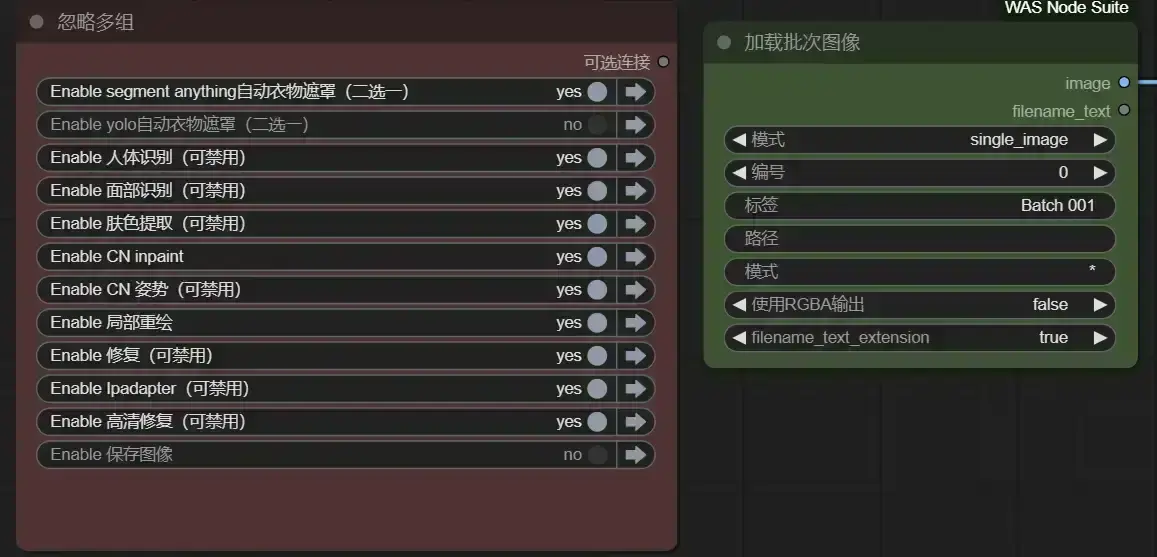

如图我配置了非常多的可调节选项(节点管理),也加入了批量处理节点,各选项的具体说明已经写在工作流的注释里了。

插件配置

完成了基础篇的前置工作后,建议更新comfyui本体和所有插件到最新版(直接在manager那里更新全部)。跟基础篇里的工作流相比,正式版还额外调用了以下节点和模型:

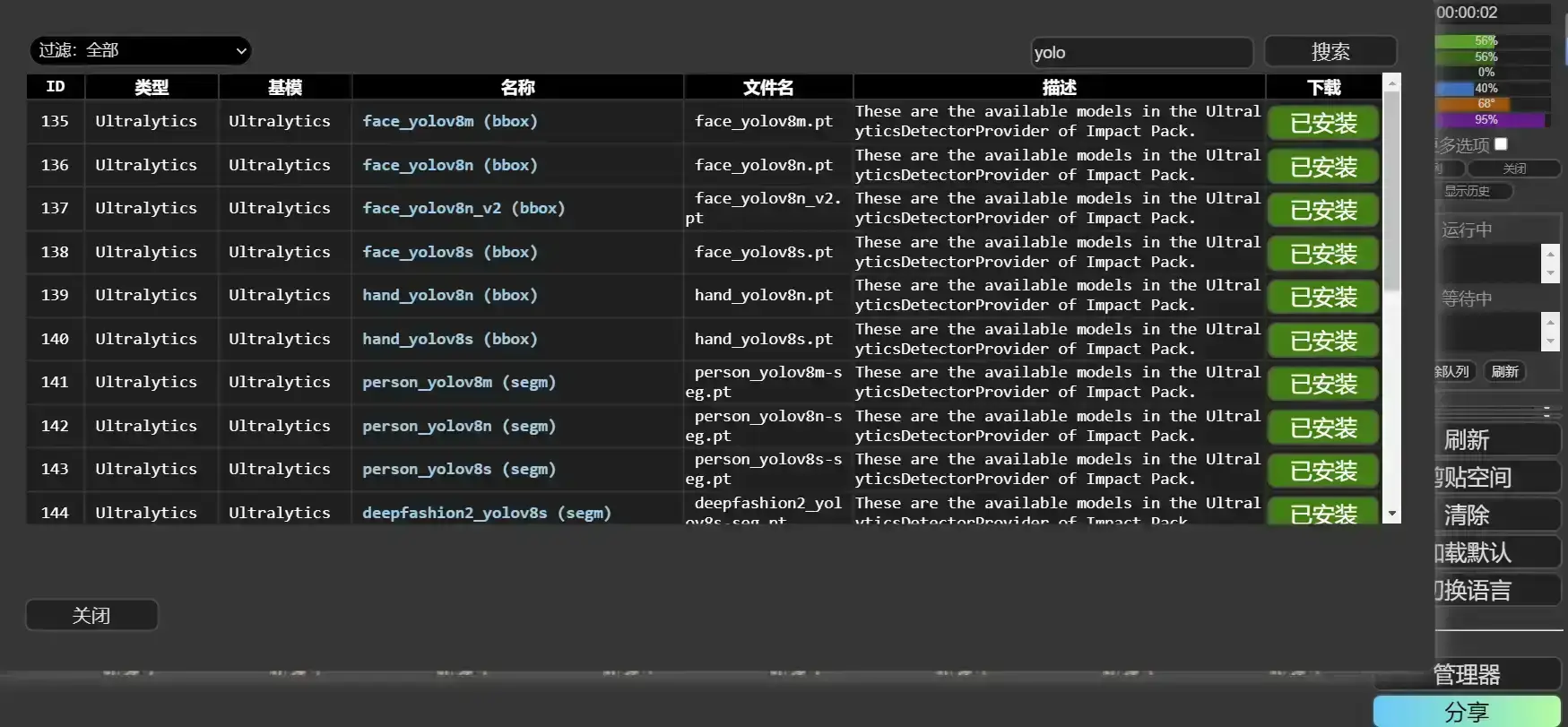

1. yolo模型

新工作流调用了impact节点下的各种yolo模型,你可以通过comfyui manager(管理器)——安装模型——搜索“yolo”,直接下载所有这些模型

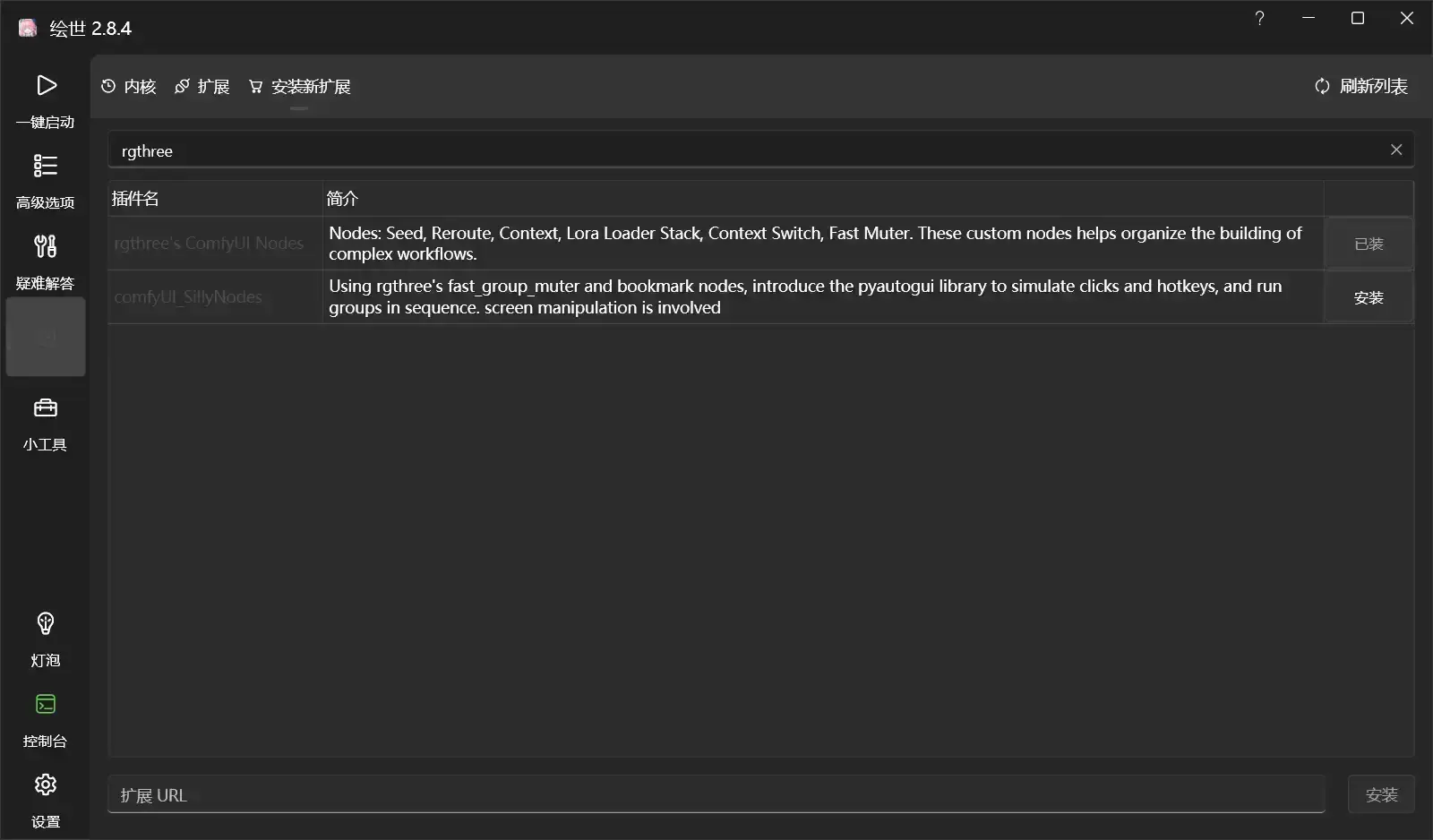

2. rgthree插件

节点管理插件,直接通过秋葉启动或者管理器安装即可

3. Ipadapter模型

风格迁移插件,秋葉整合包自带ComfyUI_IPAdapter_plus插件,但模型需要额外下载

https://github.com/cubiq/ComfyUI_IPAdapter_plus

(打不开的去秋葉启动器设置里打开网站镜像代理再搜索插件,去到对应镜像网站)

CLIP-ViT-H-14-laion2B-s32B-b79K.safetensors,下载并重命名,放到 /models/clip下;

ip-adapter-plus_sd15.safetensors,下载放到 /models/ipadapter/下;

除此以外你也可以下载使用github里提到的其他模型(一次性全下载得了,未来新的工作流可能会用到)。

Ipadapter_plus插件目前有个小bug,节点有可能无法识别出文件夹下的Ipadapter模型,你需要打开comfyui根目录下的folder_paths.py,在其中插入一行

folder\_names\_and\_paths["ipadapter"] = ([os.path.join(models\_dir, "ipadapter")], supported\_pt\_extensions)

每次更新comfyui都需要重新粘贴一次

4. WAS节点修改

当然还有在教程三里提到过的肤色提取,你需要将以下代码覆盖到\custom_nodes\was-node-suite-comfyui\WAS_Node_Suite.py的"class WAS_Image_Select_Color:"类里(如果以后更新了该节点,需要重新覆盖)

https://mega.nz/file/EPcnRBBD#pvmKaY6pT27-igPeRMHkdvvYPkOG-Fks-2sVyhudjCk

初次使用

讲完了插件配置,首次使用该工作流你还可以依据自身需求调节以下节点:

Segment Anything

你可以根据你的显存大小设置调用的SAM模型,

显存>=12G:2.5G

显存>=8G:1.25G

显存<8G:370M

如果你的显存不足8G,可以在节点管理里二选一禁用Segment Anything并使用隔壁yolo模型节点,我感觉差距不大,yolo模型还更快些。

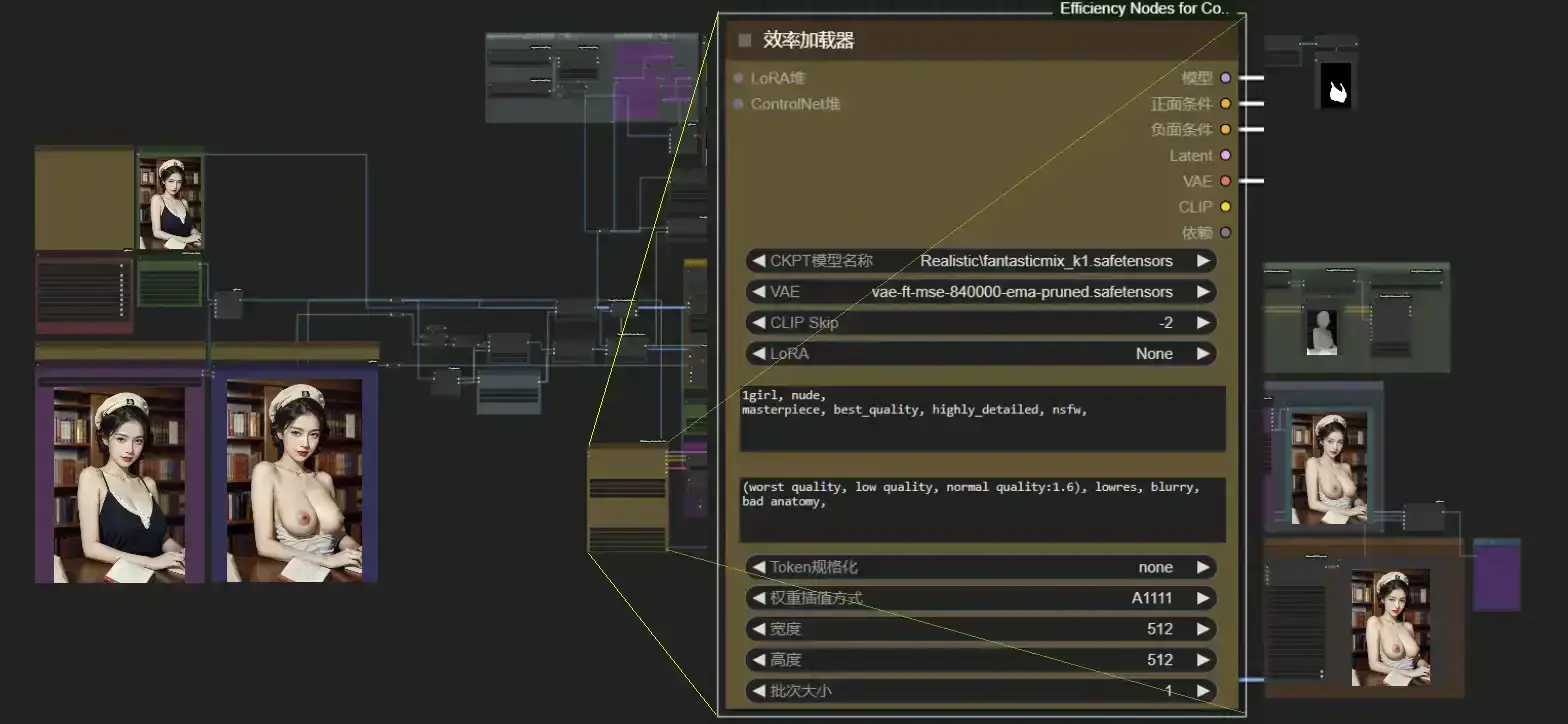

ckpt模型与VAE

如图你需要在{效率加载器}这里选用你中意的大模型与VAE(详见基础篇),并根据模型调整正负面提示词(不要使劲加高提示词权重,如果去衣效果不理想,那是遮罩和蒙版的问题,多尝试几次或者加入手绘遮罩辅助远比提示词可靠)

调整完后shift+S保存工作流,之后的使用基本只要关注节点管理就行了。剩下的问题你应该能在工作流注释里找到答案(注释在节点管理上方)。

别再问预处理器加载以及各种网络问题了,换个好点的梯子比什么都靠谱

自动去衣v1.0工作流

https://mega.nz/file/dXV0CKSK#935Rbtf3Pc_VUnxMuEoZ0eUrnpc3umi4aetRpz0yloc